背景

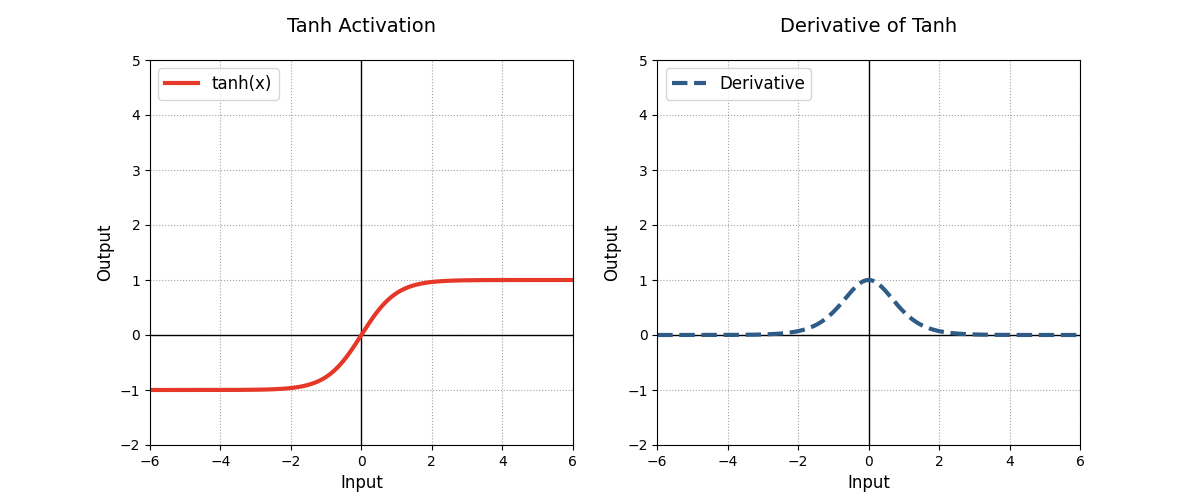

Tanh(双曲正切)激活函数是Sigmoid函数的改进版本,提出动机主要为了解决Sigmoid函数输出非零中心化的问题。在Sigmoid函数中,输出值范围为,导致后续层输入的均值偏移(非零中心),使得神经网络在反向传播时参数更新效率降低。

原理

其中为Sigmoid函数

导数

优缺点分析

优点

- 零中心输出

- 输出均值为0,后续层的输入分布更对称,有助于缓解梯度更新的方向偏差,加速梯度下降收敛。

- 比Sigmoid梯度更大

- 最大梯度为1,Sigmoid最大为0.25,反向传播时梯度衰减问题略优于Sigmoid。

- 可解释性

- 负值表示抑制,正值表示激活。

缺点

- 仍存在梯度消失问题

- 尤其是当输入绝对值较大时。

- 计算量大

- 大于ReLU系列函数,但小于Sigmoid。

- 神经元饱和问题

- 输入值过大或过小时,神经元进入饱和状态,输出接近±1,导致梯度接近0,训练停滞。需要谨慎的初始化权重(Xavier)。